纯视觉向左融合感知向右,智能辅助驾驶技术博弈升级

文 | 极智 GeeTech

近期,特斯拉官方微博发文强调其视觉处理方案的重要性,宣称 " 坚持视觉处理方案,让人人买得起安全智能的产品 "。

就在上个月,特斯拉 CEO 埃隆 · 马斯克通过社交平台 X 宣布,特斯拉即将推出基于纯人工智能技术的 " 通用型全自动驾驶(FSD)解决方案 "。这一方案延续了公司自 2016 年起坚持的 " 视觉优先 " 战略,将彻底抛弃激光雷达,仅靠摄像头和自研芯片实现 L4-L5 级自动驾驶。

一边是特斯拉 All in 纯视觉方案,另一边是激光雷达的热销。国际市场研究与战略咨询机构 Yole Group 发布《2025 年全球车载激光雷达市场报告》显示,全球乘用车激光雷达市场持续高速增长,2024 年同比扩增 68%,市场规模攀升至 6.92 亿美元。截至 2025 年 3 月底,中国全市场有交付量的激光雷达配置车型达到 94 款,相比上一年度翻了一倍。

禾赛 CEO 李一帆曾在技术开放日上表示,车载激光雷达正从 " 可选功能件 " 进化为 " 必选安全件 ";同时,用了 8 年左右的时间,将激光雷达的成本砍掉了 99.5%(从数千美元降至 200 美元左右)。

在智能辅助驾驶领域,激光雷达与纯视觉的路线之争已持续很长时间,至今仍无定论。无论是仅用摄像头的 " 纯视觉派 ",还是采用激光雷达 + 毫米波雷达 + 摄像头的 " 多传感器融合派 ",这场分歧的本质,是技术理念、成本逻辑与市场策略的三重博弈,预示着智能辅助驾驶技术路线之争将再度升级。

通向完全自动驾驶 " 第一性原理 "

特斯拉在发文中表示,公司的视觉处理方案搭配端到端神经网络架构,已通过数十亿真实世界数据样本训练,成功实现了多场景、更安全的智能驾驶技术路径。这一表态进一步确认了特斯拉在智能辅助驾驶领域的技术选择与战略定位。

与业内其他依赖激光雷达等多传感器融合方案不同,特斯拉强调 " 用实力证明先进的技术不需要昂贵繁杂的传感器 "。

众所周知,特斯拉的 FSD 智能辅助驾驶系统是当前世界唯一的纯视觉方案,甚至连毫米波雷达都已弃用,只依靠摄像头和 AI 系统。

早在 2021 年,马斯克在接受媒体采访时就曾声称:" 自动驾驶汽车应当使用与人类司机相同的感觉驾驶汽车,人依靠眼睛和智力驾驶汽车,自动驾驶汽车也应当这样。"

马斯克认为,道路和交通规则本身是基于人类视觉设计的,纯视觉方案能最贴近人类驾驶习惯,是通向完全自动驾驶的 " 第一性原理 "。他多次批评激光雷达是 " 错误的解决方案 ",称其在复杂道路环境中效率低下,而视觉系统结合生物神经网络才是最优解。

之所以特斯拉只采用视觉方案,是为了让车载计算机更加 " 专注 ",一旦增加雷达等相关数据,会使系统获得超过它处理能力的冗余数据,如此会对软件产生负面影响。

从技术角度看,纯视觉方案是一种基于摄像头感知系统的技术路线,其核心思路是利用摄像头捕捉环境的 RGB 图像数据,通过深度学习算法提取语义特征,完成对车辆周围环境的感知、识别和决策。

这一方案的最大特点在于其以算法为核心驱动,通过模拟人类的视觉系统实现对复杂驾驶场景的理解。

近年来,随着计算机视觉和深度学习技术的快速发展,纯视觉方案的感知能力显著提升,尤其是在物体检测、目标跟踪和路径规划等关键任务上取得了突破性进展。

从方案部署角度,纯视觉方案主要依靠摄像头这一单一硬件,降低了系统集成难度和硬件成本。但其依赖的算法对场景的高效感知与理解,特别是在恶劣天气(如大雾、大雨或积雪环境)和受光照条件影响较大的复杂工况下,如何确保可靠性仍是其核心挑战之一。

其次,该方案需要处理大量的图像数据,这对自动驾驶系统的数据处理和存储能力提出了更高的要求,增加了系统的复杂性和能耗。

而国内虽然也有宣称纯视觉方案,实际上应该是 " 主视觉 ",因为除了摄像头,当前依旧保留了有其他传感器,只是去除了激光雷达。

今年 4 月,特斯拉 CEO 埃隆 · 马斯克通过其社交平台宣布,特斯拉即将推出基于纯人工智能技术的 " 通用型全自动驾驶(FSD)解决方案 "。

从市场反馈看,特斯拉 FSD 在北美市场渗透率超 30%,虽然纯视觉方案在美国表现出了优异性能,但可能低估了中国路况的复杂程度。相比之下,中国车企更擅长结合中国的实际道路环境开发智能辅助驾驶技术,从而在驾驶风格、安全性等层面实现 " 超车 "。比如针对常见的 " 鬼探头 "" 加塞 " 情况,中国车企都会在方案中加入更有针对性的解决办法。

从效果来看,中国市场中大多数高阶智能辅助驾驶已经拥有了相当出色的完成度,而针对中国路况的优化又会带来更多安全感,这些都是纯视觉方案暂时没有的特质。

将传感器武装到牙齿的 " 安全冗余 "

自动驾驶的四大核心技术分别为环境感知、精确定位、路径规划、线控执行。实际的自动驾驶汽车面对的路况远比实验室仿真或者试车场的情况要复杂得多。因此,在行车过程中,自动驾驶汽车需要准确识别周边环境,尤其是实时动态环境数据的精准识别与分析。

在自动驾驶感知系统中,环境感知的核心目标是全面了解周围环境中的静态和动态元素,包括车道线、交通标志、其他车辆、行人以及可能存在的障碍物。通过对这些元素的准确感知,车辆能够在复杂的交通场景中构建清晰的环境模型,为后续的驾驶决策提供可靠依据。

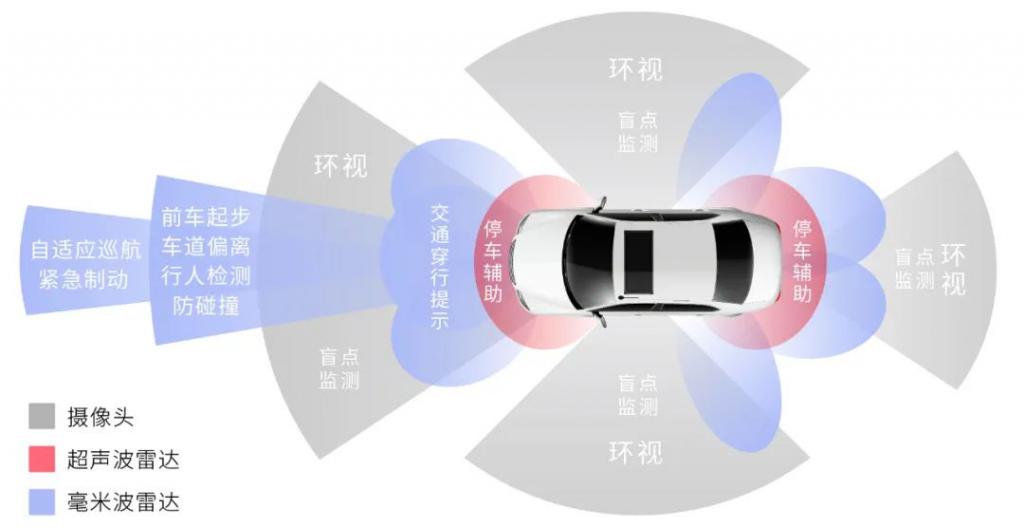

环境感知是通过摄像头、传感器、雷达对自动驾驶行为的参与方环境的监控以及信息获取,完整的环境感知技术方案需要多方的信息协调构成。其中摄像头可大致分为单目摄像头、双目摄像头、环视摄像头等;雷达可分为激光雷达、毫米波雷达和超声波雷达等,因各种雷达原理不同,其性能特点也各有千秋,可实现不同的功能。

感知系统的实现依赖于多个技术模块的协同运作,其中包括传感器数据采集、特征提取、数据融合以及语义分析等。

数据采集是感知系统的起点,通过激光雷达、摄像头、毫米波雷达、超声波雷达等多种传感器的协作,感知系统能够覆盖从远距离到近距离的全方位感知需求。

特征提取则通过复杂的算法从原始数据中提取如检测车辆边界、分割行人轮廓以及识别道路标志等有价值的信息。

随后,系统通过数据融合技术将来自不同传感器的信息整合为统一的环境模型,以弥补单一传感器可能存在的缺陷。比如,激光雷达的数据可以提供高精度的三维点云,但难以区分物体类型,而摄像头可以补充视觉信息,增强系统的语义识别能力。

此外,自动驾驶感知系统的设计还需要满足高效性和可靠性的要求。在复杂的驾驶场景中,系统需要在极短的时间内处理大量数据,并给出准确的识别和分析结果。

因此,现代感知系统通常借助人工智能技术,特别是深度学习算法,在目标识别和分类方面取得了显著的进展。为了应对各种极端天气和光照条件的挑战,感知系统在传感器硬件设计和算法鲁棒性方面也进行了多层优化。

多模态传感器技术是感知系统的基础,也是感知能力的重要保障。每种传感器针对不同应用场景发挥其独特作用。

激光雷达最大优势在于测距精度非常高,通常可以达到厘米级别,远高于传统的雷达和摄像头技术。

通过高密度、高精度的三维点云数据,激光雷达能够精确感知周围环境中的物体位置、形状和距离,被广泛应用于构建周围环境的几何模型,特别是在复杂城市场景中,它的高空间分辨率和测距能力极大地提高了障碍物识别和建图精度。

激光雷达不依赖环境光照条件,能够在白天、夜晚以及光线复杂的环境中工作,这使得激光雷达特别适用于多变的户外环境,如城市街道、隧道和夜间驾驶等场景。

摄像头作为模拟人眼的视觉工具,能捕获丰富的语义信息,用于识别车道线、交通标志、行人和车辆类型等。摄像头在晴天和光照良好的条件下表现出色,但强光、阴影和夜间等复杂光照条件会显著降低其性能。

毫米波雷达在感知速度和距离信息方面表现优异,尤其在雨雪天气和低可见度环境中,能够可靠工作。但其空间分辨率不足以精确识别静态或复杂形态的物体。

超声波雷达则更多应用于如泊车场景中的障碍物检测短距离环境感知,但其探测距离较短,无法满足复杂场景需求。

因此,为了克服单一传感器的局限性,多传感器组合已成为自动驾驶的主流解决方案。相比于依靠摄像头的纯视觉感知方案,激光雷达与摄像头的融合感知方案,可以带来全局信息获取能力的提升,为行驶安全增添了多重保障。

以华为、理想汽车为代表的企业是激光雷达的坚定拥护者。华为智能汽车解决方案 BU CEO 靳玉志在公开场合曾表示,未来走向 L3、L4 级自动驾驶时,汽车必须配备激光雷达。

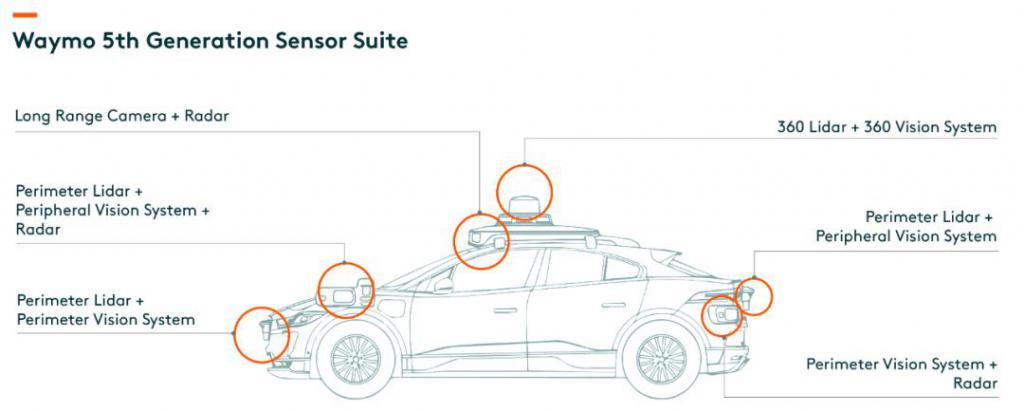

比如 Waymo 的第五代 Robotaxi,配备了 8 颗摄像头、5 颗雷达和 3 颗激光雷达,而第六代 Robotaxi 更是配备了 13 颗摄像头、4 颗激光雷达、6 颗毫米波雷达以及一系列外部音频接收器,为驾驶员提供 360 度环视视野,最远探测距离达 500 米,极大提升了车辆在不同光照条件、极端天气下的适应能力。

在 2024 年 12 月的理想 AI Talk 对话节目中,理想汽车 CEO 李想被问及 " 特斯拉没有用激光雷达,你们为什么要用 " 时,他坦言保留激光雷达是为了安全。

李想表示,中国路况与美国不同,深夜驾驶时可能会遇到尾灯损坏的大货车,甚至大货车会停在主路上。在这种情况下,激光雷达可以看到 200 米远的距离,而摄像头在无光环境下的可视距离只有 100 多米。这使得激光雷达能够实现 130 公里 / 小时的 AEB 自动紧急制动功能。

AEB 的关键性能指标包括刹停速度与误报率,激光雷达能实现更远距离的探测,对物体的检测也更加灵敏,在高速场景里保证了更高的刹停速度,在城区里则有效降低误报率。因此,不少业内人士认为,激光雷达除了承担安全冗余的角色,更是实现 AEB 功能必不可少的感应器,是 " 功能件 "。

事实上,特斯拉与国内车企的路线分歧本质是 " 算法驱动 " 与 " 硬件驱动 " 的理念之争。特斯拉压押注于通过海量数据训练出 " 全能算法 ",最终实现 " 无雷达 " 的纯视觉自动驾驶;而国内车企则选择用硬件堆砌安全冗余,通过多传感器互补应对复杂场景。

单一技术的安全威胁在于安全冗余能力的不足,视觉可能 " 看不见 ",激光雷达可能 " 看不懂 "。在真实场景中,一场大雾足以让视觉系统失效,一个反光物体可能让激光雷达误判,任何单一传感器的 " 脆弱性 " 都可能成为系统性风险的导火索。

通过将激光雷达、摄像头、毫米波雷达等多种传感器的感知数据进行融合处理,能够提供更为准确、完整的环境信息。这种融合感知技术能够充分利用各种传感器的优势,通过在时间和空间上对不同传感器的信息进行对齐和优化,从而弥补单一传感器的缺陷。

比如在融合激光雷达和摄像头时,激光雷达提供准确的空间位置和深度信息,而摄像头则补充色彩、纹理等语义信息,二者结合能够实现更全面的目标检测和识别。

不过,融合感知技术的推广仍面临成本、技术和法规等多方面的挑战。首先,融合感知技术需要集成多种传感器,这增加了系统的复杂性和成本。其次,不同传感器之间的数据融合需要高精度的校准和同步,这对技术实现提出了很高的要求。

单车智能之外的另一条路径

虽然特斯拉不断为纯视觉路线摇旗呐喊,但目前纯视觉路线仍未是智驾的终局,美国针对纯视觉路线的反思与讨论从未停歇。出于安全的考虑,激光雷达也还远未到被淘汰之时,其作为车企的重要营销卖点,短期内都不会出现变化。

从国内的技术能力出发,现阶段要实现去激光雷达还有难度。特斯拉之所以捍卫纯视觉路线,是基于其在数据、算力与算法三方面的巨量投入。

在考虑成本的时候,不能够只看到硬件成本,实际上更要考虑背后所需要各种研发服务和资源投入,也就是 " 全成本 " ——除了冰山上面的显性成本,还有大量被忽视的隐性成本,包括算法、路测、云计算、数据标注、仿真训练和系统软件等。

换句话说,特斯拉作业并不好抄,其用数据和算力构建起的门槛和壁垒都极高。

早期,智能辅助驾驶供应链刚刚起步,激光雷达尚未能达到相当稳定的性能表现,且造价高昂,以万元为单位,车企们望而却步,激光雷达只能搭载在 Robotaxi 以及高端车型。

但随着产业发展,激光雷达已经有了更高的可靠性与成本表现,售价降至千元级别,这也是高阶智能辅助驾驶能够逐步下沉的根本原因。

今年,高阶智能辅助驾驶来到了 20 万元以内的汽车市场,在这个价格带里,选择激光雷达上车的车企越来越多。

实际上,只要成本降到一定程度,车企就无法拒绝激光雷达的上车,因为激光雷达与先进的算法架构并不冲突,反而能提升智能辅助驾驶系统的鲁棒性。

除了单车智能,通过 AI 网络紧密连接路侧传感器、车载终端、云端算力中心等各个节点要素,实现对环境数据信息的实时感知、智能决策与精准控制,可根据不同交通场景动态调配计算资源,支持超视距感知、多车协同控制、交通流优化等复杂任务。

通过与大模型相互配合,AI 网络构建起实时物理世界数字镜像,通过多样化的传感器融合、边云协同计算与城市级 V2X 部署,系统可感知整条路径上的交通动态,并实时推送给前后车辆,实现集体智慧下的自主决策,从而将 " 单车智能 " 进化为 " 系统智能 "。

当前,智能辅助驾驶正从早期试点迈向规模化普及阶段,这一过程需要技术创新与用户体验的平衡共进。激进的技术冒进可能对行业普及进程造成冲击,而以用户为中心的安全体验远胜于技术 " 炫技 "。

智能辅助驾驶的行业终局尚未明晰,但行业共识已然清晰:无论技术路径如何选择,安全始终是不可逾越的底线。在关乎生命安全的领域,稳步构建可靠的技术体系,让用户在每一次出行中感受到有温度、可信赖的技术守护,才是智能辅助驾驶技术普惠大众的正确打开方式。